Las funciones de salud de ChatGPT no detectan con fiabilidad “emergencias de alto riesgo” ni identifican cuándo una persona necesita atención médica inmediata, según un nuevo estudio científico.

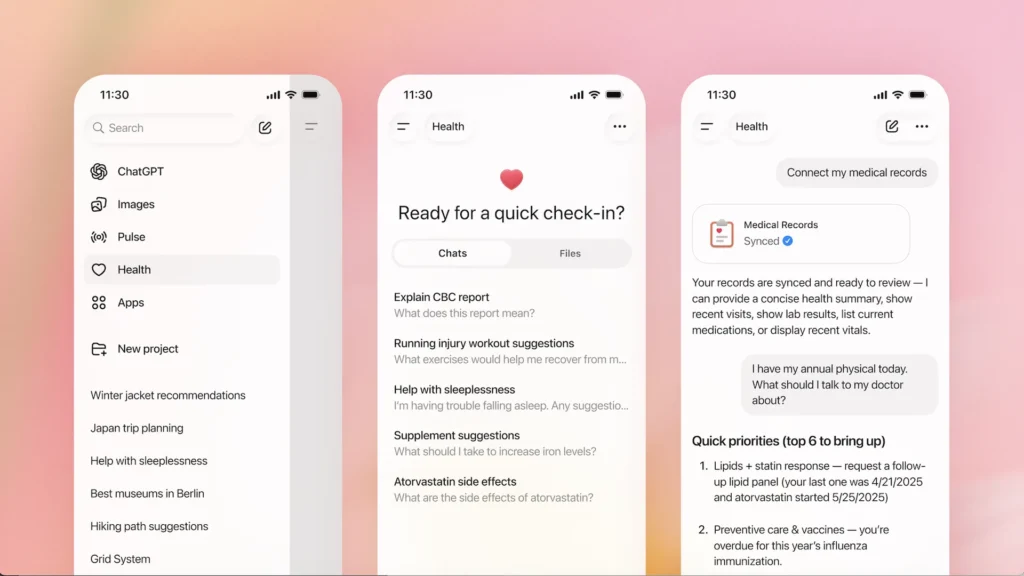

Las consultas sobre salud se han convertido en uno de los usos más comunes de los chatbots de inteligencia artificial como ChatGPT, de acuerdo con su creador, OpenAI. A principios de este año, la empresa presentó la herramienta ChatGPT Health, orientada a ofrecer orientación sobre bienestar, y afirma que decenas de millones de personas ya la utilizan.

Sin embargo, una investigación reciente sugiere que el sistema podría pasar por alto emergencias importantes, por lo que no siempre es fiable para indicar cuándo alguien debe buscar atención médica urgente.

“Los grandes modelos de lenguaje se han convertido en la primera opción de consulta médica para los pacientes, pero en 2026 son menos seguros en los extremos clínicos, donde el criterio distingue entre emergencias pasadas por alto y alarmas innecesarias”, señaló Isaac S. Kohane, de la Facultad de Medicina de Harvard.

“Cuando millones de personas utilizan un sistema de IA para decidir si necesitan atención de emergencia, hay mucho en juego. La evaluación independiente debería ser rutinaria, no opcional”.

Investigación evaluó casos médicos simulados

El estudio fue realizado por investigadores de la Icahn School of Medicine at Mount Sinai y publicado en la revista científica Nature Medicine.

Los especialistas decidieron analizar el desempeño de la herramienta ante posibles emergencias médicas, debido a que cada vez más personas recurren a sistemas de inteligencia artificial para obtener orientación sanitaria.

“Queríamos responder a una pregunta muy básica pero crucial: si alguien sufre una emergencia médica real y acude a ChatGPT Health en busca de ayuda, ¿le indicará claramente que debe acudir a urgencias?”, explicó el autor principal del estudio, el urólogo Ashwin Ramaswamy.

Hallazgos generan preocupación

Para la investigación, los médicos elaboraron 60 escenarios clínicos que abarcaban 21 especialidades médicas, desde situaciones de bajo riesgo hasta emergencias reales.

También incluyeron 16 condiciones contextuales, como variables de raza y género.

Entre los resultados más relevantes, los investigadores detectaron que:

- El sistema identificaba correctamente las emergencias más evidentes.

- Sin embargo, fallaba en más de la mitad de los casos donde los médicos consideraban necesaria atención urgente.

- En algunos escenarios, las alertas parecían invertidas: cuanto mayor era el riesgo de autolesión, menor era la probabilidad de que se activara una advertencia.

Los investigadores señalaron que, aunque la herramienta puede ser útil en ciertos contextos, su desempeño es menos confiable cuando el peligro no es inmediato o evidente.

El estudio se publicó bajo el título “Rendimiento de ChatGPT Health en una prueba estructurada de recomendaciones de triaje” y fue difundido de forma acelerada en Nature Medicine.